OpenClaw爆紅帶動Mac mini搶購潮 AI PC戰場蘋果默默勝出

- 相較於鼓吹AI PC概念多年的Windows陣營,Mac憑借macOS的UNIX底層架構、統一記憶體設計與靜音低功耗特性,在AI代理部署領域建立起難以撼動的實用優勢,形成「Windows喊得響亮,Mac默默賺錢」的反差局面。

- AI代理應用OpenClaw(前身為Clawdbot)在2026年初掀起全球開發者搶購潮,蘋果Mac mini意外成為首選硬體,交貨期延長至六周甚至兩個月。

- macOS的UNIX血統成關鍵優勢 Mac在AI開發領域的主導地位,根源在於macOS流著UNIX的血液。

- 統一記憶體架構的技術突破 蘋果M系列晶片的統一記憶體架構(Unified Memory Architecture) 是Mac mini能勝任AI本機推理的關鍵技術突破。

AI代理應用OpenClaw(前身為Clawdbot)在2026年初掀起全球開發者搶購潮,蘋果Mac mini意外成為首選硬體,交貨期延長至六周甚至兩個月。這股熱潮並非來自蘋果行銷策略,而是開發者社群自發選擇——他們需要一台能7×24小時運行、功耗極低且能本地部署大模型的「肉身」電腦。相較於鼓吹AI PC概念多年的Windows陣營,Mac憑借macOS的UNIX底層架構、統一記憶體設計與靜音低功耗特性,在AI代理部署領域建立起難以撼動的實用優勢,形成「Windows喊得響亮,Mac默默賺錢」的反差局面。

OpenClaw熱潮引爆硬體需求

OpenClaw的爆紅徹底改變了Mac mini的市場定位。這款AI代理的核心價值在於讓大語言模型能夠實際操作電腦——讀取檔案、執行命令、操控軟體介面,如同一位不知疲倦的數位助理。雲端伺服器雖能運行OpenClaw,但缺乏使用者的檔案系統、瀏覽器登入狀態與軟體環境,無法建立真正的「上下文理解」。Mac mini恰好填補這個關鍵缺口:體積小巧可置於桌角,待機功耗僅10-40瓦,無需連接螢幕即可遠端操控,成為AI代理理想的「物理載體」。

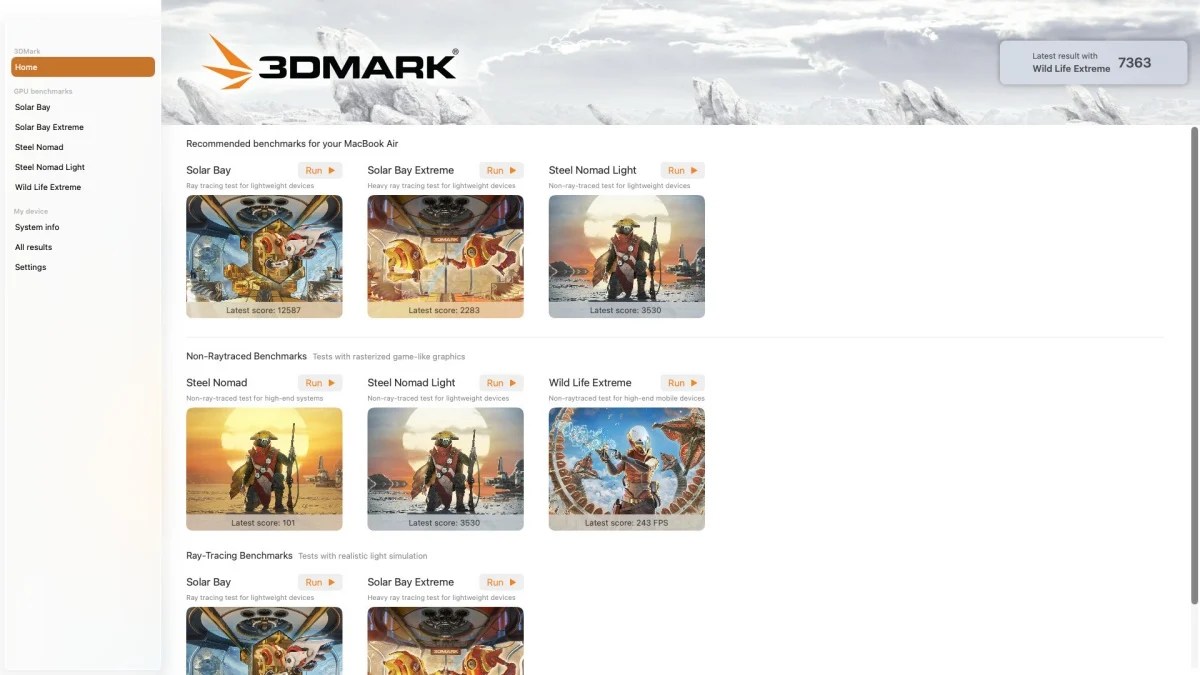

Tom's Hardware與TechRadar等外媒證實,OpenClaw熱潮導致Mac mini 24GB與32GB機型交貨期延長至六天到六周,高階Mac Studio更從兩周拉長至兩個月。這波需求來自真實開發者的投票,他們計算過成本效益:若採用雲端API作為後端,token費用將迅速累積成可觀開支;反之,購買規格足夠的Mac mini,下載量化後的大型模型在本機運行,除了電費與網路費,幾乎等於擁有免費助理。以運行320億參數模型為例,經過4-bit量化後約需20GB記憶體,Mac mini M4 Pro搭配48GB統一記憶體的配置,整機價格遠低於搭載24GB顯存的NVIDIA RTX 4090主機,後者僅顯卡成本就超過六萬元,完整系統更可能突破二十萬元。

值得注意的是,蘋果近期推出新款Mac桌機也加劇缺貨狀況,但OpenClaw無疑是主要推手。這股熱潮揭示了一個尷尬現實:英特爾、AMD、高通與PC品牌廠自2023年起大力宣傳的AI PC概念,在真實AI開發場景中幾乎沒吃到任何紅利。Copilot+ PC認證、NPU性能規格等行銷術語,未能轉化為開發者的實際選擇。

macOS的UNIX血統成關鍵優勢

Mac在AI開發領域的主導地位,根源在於macOS流著UNIX的血液。AI代理的核心工作是操作檔案、調用命令列工具、調度API與控製圖形介面,本質上是一位「智慧化的腳本工程師」,而腳本由大語言模型即時生成。macOS作為類UNIX系統,原生支援bash、zsh等命令列介面,從Python環境到複雜的C++編譯工具鏈皆開箱即用,Homebrew套件管理器更讓工具安裝簡化為一行指令。

相較之下,Windows開發者需先安裝WSL2虛擬機器,在相容層上重建Linux環境。這個額外步驟帶來路徑規範、登錄檔機制、權限模型等歷史遺留問題,增加執行摩擦力。以Ollama與LM Studio兩大本機推理工具為例,Ollama的Windows版本比macOS晚了半年推出;LM Studio雖雙平台同步,但社群口碑始終偏好Mac版本。這種原生性與穩定性的差異,讓開發者能將時間真正花在編排代理邏輯,而非解決環境相容問題。

更深層的技術優勢在於macOS符合POSIX標準,處理檔案路徑、多執行緒任務與網路協定時可靠性更高。AI代理需頻繁讀寫數據、調用API,系統級高效調度讓代理在Mac上的運行節奏更流暢。Windows雖有PowerShell與WSL,但終究是疊加在NT核心上的相容層,當AI模型需要直接調用系統資源時,Mac的UNIX底層展現出無可比擬的整合度。

統一記憶體架構的技術突破

蘋果M系列晶片的統一記憶體架構(Unified Memory Architecture) 是Mac mini能勝任AI本機推理的關鍵技術突破。傳統PC架構中,CPU記憶體與GPU顯存物理分離,數據需通過PCIe總線傳輸,頻寬瓶頸嚴重限制大型模型推理速度。Mac的CPU、GPU與神經計算引擎共用同一記憶體池,消除數據搬移損耗,實現極高記憶體頻寬。

以運行OpenClaw推薦的320億參數模型為例,量化後模型約需20GB記憶體,加上上下文視窗保留空間,32GB統一記憶體的Mac mini M4機型即可滿足需求。若追求更高token吞吐速度,M4 Pro處理器搭配48GB記憶體的配置,整機價格仍遠低於同級PC方案。這種性價比在AI推理專用場景中格外突出。

反觀Windows PC,即使搭載NVIDIA RTX 4090這類24GB顯存顯卡,模型仍需在CPU記憶體與GPU顯存間頻繁交換數據,PCIe頻寬成為性能瓶頸。若要將更大模型完全載入顯存,需購買RTX 4090或更昂貴的專業卡,整機成本瞬間飆升。統一記憶體的另一優勢在於多機串聯擴展性更佳,對於需要部署多個AI代理的企業用戶,Mac mini的叢集配置成本效益顯著。

然而必須釐清,統一記憶體與獨立顯存並非完全對等。32GB的Mac mini中,macOS系統與其他軟體需佔用數GB記憶體;而RTX 3090的24GB顯存可全數供模型使用,甚至搭配CPU記憶體運行更大量化模型。但對於純推理場景,Mac的記憶體架構效率優勢明顯,特別是處理prefill階段與動態上下文加載時,統一記憶體的低延遲特性讓AI代理反應更迅速。

功耗與靜音設計的隱性價值

AI代理的工作模式是持續性的循環:任務觸發、思考推理、執行、等待、再觸發。這種7×24小時運行特性讓功耗與散熱成為關鍵考量。Windows PC本地部署時整機功耗可達300-400瓦,風扇噪音與電費都是可觀成本;Mac mini待機功耗僅10-40瓦,峰值功率65瓦(M4)或155瓦(M4 Pro),散熱可控且幾乎無風扇噪音。

這種低功耗、靜音的持續運行方式,創造出「不知不覺」的體驗差異。開發者可將Mac mini置於辦公室角落,長期運行而不影響工作環境。工程師Manjeet Singh逆向工程M4處理器的神經引擎(ANE)發現,ANE在算力滿載時效率高達6.6 TOPS/W,相較之下M4 GPU約1 TOPS/W,NVIDIA H100僅0.13 TOPS/W,A100更低至0.08 TOPS/W。雖然A100單卡吞吐性能是M4 ANE的50倍,但M4 ANE的功耗效率竟是A100的80倍,對終端推理而言,這種能效比極具吸引力。

低功耗設計也反映在長期使用成本上。以一年不間斷運行計算,Mac mini的電費支出可能僅為高階PC的十分之一。對於需要部署多個AI代理的新創公司或研究團隊,這種運營成本差異足以影響採購決策。Mac mini的體積優勢同樣不可忽視,如同只要桌角空間就能放置的「伺服器節點」,在寸土寸金的都市辦公環境中更具彈性。

神經引擎的十年佈局

蘋果在AI硬體的佈局可追溯至2011年A5處理器的影像訊號處理器(ISP),當時已能硬體實現臉部即時檢測等機器學習任務。2014年收購PrimeSense後,蘋果開始研發專用於神經網絡計算的處理器,2017年iPhone X搭載的A11 Bionic首次整合神經引擎(Neural Engine, ANE),算力僅0.6 TOPS,卻足以驅動Face ID與人像模式。

當時市場對此反應冷淡,AI尚未進入大模型時代,主要應用仍限於傳統機器學習演算法。但蘋果持續加碼,M1發表時ANE算力躍升至11 TOPS,M2達15.8 TOPS,M3為18 TOPS,M4大幅提升至38 TOPS,預計2025年底M5將達57 TOPS。從M1到M5,蘋果ANE算力增長超過五倍,這種長期投入讓其他PC廠商望塵莫及。

關鍵在於蘋果擁有從晶片到系統的垂直整合能力。在Mac加入AI加速硬體前,已有數億台iPhone驗證ANE架構的功耗表現、穩定性與極端案例。相較之下,英特爾與AMD在行動端缺乏消費級規模驗證,高通雖將Snapdragon置入數億台Android手機,但僅作為晶片供應商,無法像蘋果同時掌控硬體與軟體堆疊。Android的AI由Google Gemini與各家手機廠商主導,Windows的Copilot由微軟開發,蘋果則掌握從晶片、框架到應用層的完整生態。

近期發展顯示ANE角色正在擴大。M系列晶片已開始承擔提示詞注入的prefill工作,工程師更成功繞過CoreML直接調用ANE,大幅提升吞吐量。這暗示未來可能找到通用方法,利用ANE加速推理甚至訓練。2023年底蘋果開源MLX框架,將M系列晶片專用優化模型推理工具開放給開發者,搭配Apple Intelligence的基礎模型框架,讓App開發者能在本機調用內建模型,無需聯網且數據不出裝置。儘管Apple Intelligence功能一再延遲,但蘋果在AI基礎設施的十年佈局已清晰可見。

開發者的真實聲音與市場現實

OpenClaw創造者Peter Steinberger在Lex Fridman Podcast中表達的觀點,為這股熱潮增添複雜性。他明確表示更喜歡Windows,認為功能更強大,並公開吐槽蘋果在AI領域「搞砸了」,對生態封閉性深感不滿。他甚至呼籲:「請不要買Mac Mini,而是贊助Clawdbot的貢獻者」,強調WSL2運行OpenClaw已非常成熟,Amazon免費層級雲端方案同樣可行。

然而市場現實與開發者理想存在落差。對技術小白而言,Mac mini仍是門檻最低、最省事的方案。功耗、靜音、體積三大優勢,讓它成為「只要一牆角就夠用、24小時待機且無需維護」的理想選擇。社群口碑的累積效應不容忽視:當早期成功案例都在Mac平台分享,後續使用者自然跟隨路徑依賴。

這種矛盾反映AI開發領域的深層分歧:專業開發者追求開放性與自由度,願意投入時間優化Windows環境;但嘗鮮用戶與小型團隊更重視開箱即用的便利性。Mac mini恰好滿足後者需求,其成功並非技術優勢絕對碾壓,而是在正確的時間點提供了最平衡的解決方案。

未來戰局仍有變數。若Windows陣營能簡化AI開發環境配置,或雲端API成本大幅下降,Mac mini的熱潮可能降溫。但蘋果已建立從硬體架構、系統底層到開發框架的完整生態,M系列晶片的迭代路線圖明確,而Windows PC的AI體驗仍依賴多方協作。在AI代理成為主流應用之前,Mac mini的「默默勝出」恐怕還將持續。